Test setup

I already wrote on the first page that the test system still had to be changed. An overclocked and slightly undervolted AMD Ryzen 9800X3D is used on an MSI MAG X870E Carbon WiFi with 2x 16 GB T-Force Delta RGB DDR5 6000 (32 GB kit) @CL30 as well as a TB MSI Spatium M480 Pro and an M580 4TB. The whole thing is powered by a Be Quiet! Dark Power Pro 13 1600 Watt. A semi-custom water cooler from Alphacool in the form of the Eiswolf Extreme ensures a cool CPU.

I have been using an Optris Pi640 for the heat flow analyses and infrared images / radiometric videos for the non-contact measurements for years and because I had to change the system, I am using the “old” T70 benchtable from Lian Li with special foil and cover), which I can also close like a PC case. The Pi640 is an industrial camera with interchangeable lenses, various additional parts and functional software. With a whopping 640 x 480 measuring pixels, the bolometer for capturing thermal radiation is already as large as a normal VGA camera, which is interpolated into the image for optical enhancement in many cheaper devices. Not much more is currently possible. The videos are recorded at up to 30 FPS (Hz), which is also in a class of its own.

The Keyence VHX-7000 system with coupled AE-300 from my own laboratory is a versatile 3D profilometer and the powerful microscope (max. x2000) with HDR function, automated lighting scenarios and huge depth of field can also be used perfectly for such examinations. It can also be used for material analysis, for which I don’t have to use an expensive SEM EDX. Vacuum? I no longer need it and it saves a lot of time. As long as you know what you’re getting into and what the limits of the method you’re using are, it works really well. That’s exactly what we need today.

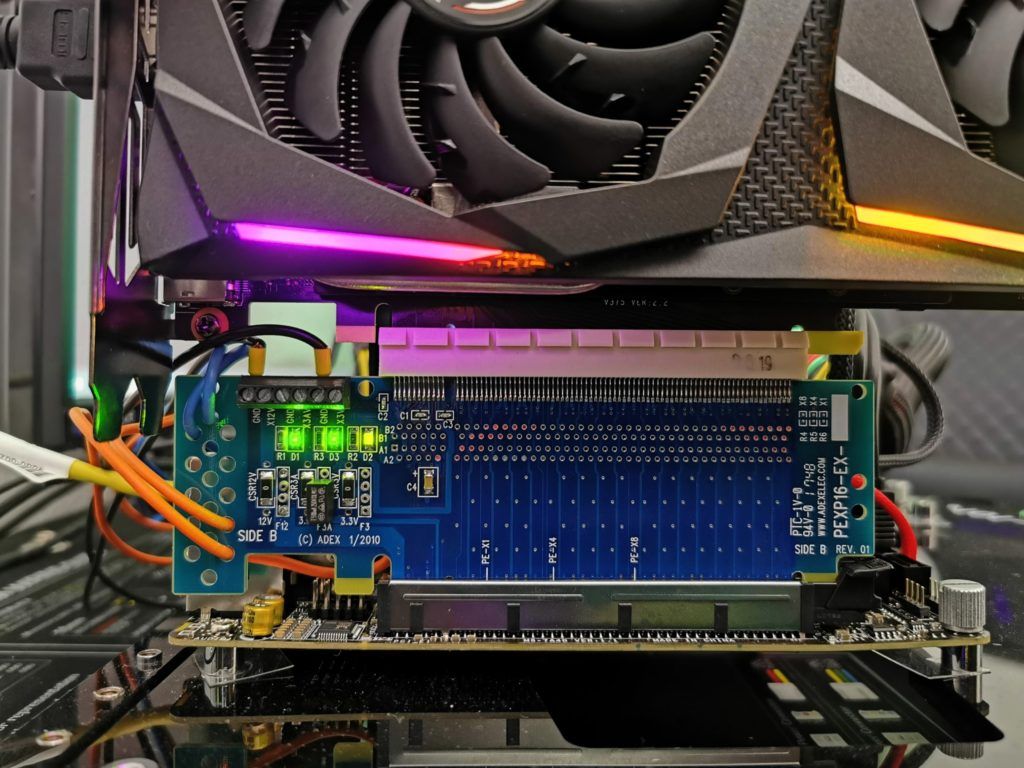

However, the measurement of detailed power consumption and other, more in-depth things is carried out in the lab using two methods: high-resolution oscilloscope technology and the self-created, MCU-based measurement setup for motherboards and graphics cards (pictures below) or NVIDIA’s PCAT. Of course, I use a redundant system with the same components because such measurements are rather difficult in the case.

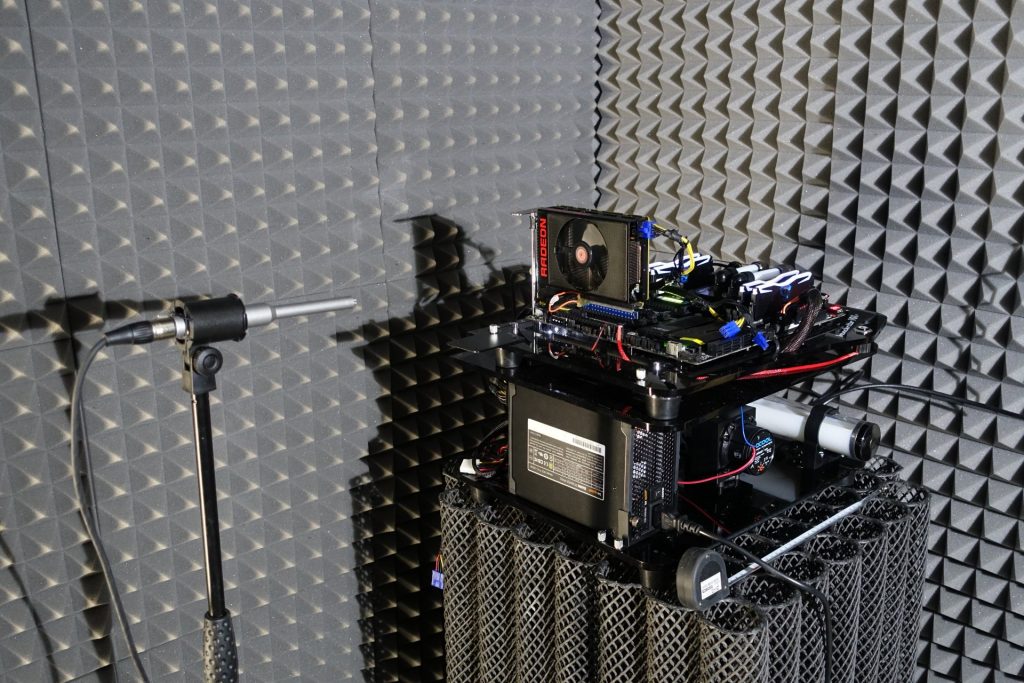

The audio measurements are carried out outside in my chamber (room within a room).

I have also summarized the individual components of the test system in a table:

| Test System and Equipment |

|

|---|---|

| Hardware: |

Ryzen 7 9800X3D MSI MAG X870E Carbon WiFi 2x 16 GB T-Force Delta RGB DDR5 6000 (32 GB Kit) @CL30 1x 2 TB MSI Spatium M480 Pro, 1x M580 4TB Be Quiet! Dark Power Pro 13 1600 Watt |

| Cooling: |

Semi-Custom Water Cooler Alphacool Eiswolf Extreme DOWSIL TC-5550 |

| Case: |

Raijintek Paean |

| Monitor: | LG OLED55 G19LA, TCL 42″ UltraHD |

| Power Consumption: |

MCU-based shunt measuring (own build, Powenetics software) Up to 10 channels (max. 100 values per second) Special riser card with shunts for the PCIe x16 Slot (PEG) NVIDIA PCAT and FrameView |

| Microscope / Laser: |

Laser-induced breakdown spectroscopy (LIBS) Keyence VHX-7000 and AE-300 |

| Thermal Imager: |

Optris PI640 Pix Connect Software Type K Class 1 thermal sensors (up to 4 channels) |

| Acoustics: |

NTI Audio M2211 (with calibration file) Steinberg UR12 (with phantom power for the microphones) Creative X7, Smaart v.7 Own anechoic chamber, 3.5 x 1.8 x 2.2 m (LxDxH) Axial measurements, perpendicular to the center of the sound source(s), measuring distance 50 cm Noise emission in dBA (slow) as RTA measurement Frequency spectrum as graphic |

| OS/UEFI: | Windows 11 Pro 24H2 (all updates/patches, current certified drivers), “Best performance” |

- 1 - Introduction and details of the GB205-300

- 2 - Test system and equipment

- 3 - Gaming: Full-HD 1920x1080 Pixels (Rasterization Only)

- 4 - Gaming: WQHD 2560x1440 Pixels (Rasterization Only)

- 5 - Gaming: Ultra-HD 3840x2160 Pixels (Rasterization Only)

- 6 - Gaming: WQHD 2560x1440 Pixels, Supersampling, RT & FG

- 7 - Gaming: Ultra-HD 3840x2160 Pixels, Supersampling, RT & FG

- 8 - DLSS4 and MFG: Cyberpunk 2077 in detail

- 9 - DLSS4 and MFG: Alan Wake 2 in detail

- 10 - PCIe 5 problems, power consumption in theory and practice

- 11 - Load peaks native vs. DLSS4, PSU recommendation

- 12 - Cooler, temperatures, thermography, noise

- 13 - Summary and conclusion

41 Antworten

Kommentar

Lade neue Kommentare

Veteran

Mitglied

Urgestein

Veteran

Veteran

Veteran

Veteran

Veteran

Urgestein

Neuling

Veteran

Urgestein

Urgestein

Urgestein

Urgestein

Urgestein

Urgestein

Urgestein

Urgestein

Alle Kommentare lesen unter igor´sLAB Community →